一文講透未來十年,天才少年的 AI 投資聖經:《態勢感知》

作者:@giantcutie666

2024年,一個00後少年天才Leopold Aschenbrenner從OpenAI離職後,開始做基金。

同時還把自己的投資思路寫了出來:

如今回頭看,這篇165頁論文《態勢感知(Situational Awareness: The Decade Ahead)》已經封神了。

去年看懂的人,今年肯定也都財富自由了!

我把165頁的英文原版放在"這裡",以下是我已經盡量精簡版的內容:

https://situational-awareness.ai/wp-content/uploads/2024/06/situationalawareness.pdf

論文的主要觀點是:這十年內人類會造出(可以勝任普通人所有工作的)AGI,緊接著是超級智能。

現在能看懂這件事的不到幾百人,大部分擠在舊金山幾條街上。其他人------包括華爾街、媒體、華盛頓------都還沒反應過來(今年華爾街的一些人也反應過來了)。

第一部分:為什麼 2027 年就有 AGI

方法很笨但有效:不預測時間,預測算力規模。

過去 4 年,從 GPT-2 到 GPT-4,模型的"有效算力"漲了大約 10 萬倍,每半年增長10倍!

GPT-2 像幼兒園小孩勉強寫半通順句子,GPT-4 像聰明高中生能考過律師資格、做博士級科學題。

這 10 萬倍來自三個地方:

第一,硬體砸錢。訓練用的算力每年漲 3 倍多。摩爾定律一年才 1.3 倍,AI 是因為人砸錢、專門造 AI 晶片,速度快了 5 倍。

第二,算法變聰明。同樣達到某個數學能力,今天的推理成本比兩年前便宜 1000 倍,這是算法工程師在卷出來的。

第三,解鎖默認被壓制的能力(unhobbling)這個最有意思。

模型本身有很多能力,但被默認設置壓住了。比如 ChatGPT 之前的 base model 其實很聰明,但用起來像胡言亂語------RLHF 解鎖了它。

又比如讓模型"想一會兒再回答"(chain of thought)解鎖了推理能力。再比如給它工具用、給它長記憶,又解鎖一層。

往後 4 年(到 2027),作者預測這三條路再加 10 萬倍。

最關鍵的洞見藏在 unhobbling 裡:

現在的模型一次推理只能"思考幾分鐘"------大約幾百個 token。如果讓它能"思考幾個月"------上百萬個 token------會怎樣?

例如你和愛因斯坦的差距,遠不如"你思考 5 分鐘"和"你思考 5 個月"的差距。

這個解鎖如果做成了,相當於額外多 3 到 4 個數量級的智能躍遷。這個果子已經看得見了。

按這個外推,2027 前後會出現一種 AI:能像遠程員工一樣獨立工作幾周,自行規劃任務、寫代碼、做實驗、修 bug、提交結果。

能完整替代一個 OpenAI 研究員,這就是作者定義的 AGI。

最大不確定性來自於數據牆------高質量公開互聯網數據快被吃完了。

第二部分:AGI 不是終點,是引爆點

一旦 AI 能做 AI 研究員的工作,會發生什麼?

算力不變,但你不再受"全球 OpenAI/Anthropic/DeepMind 加起來幾百號研究員"的限制------你可以跑1 億份 AI 研究員副本,每份以 100 倍人類速度運轉。

每幾天產出等於人類一整年的工作。

這些自動化研究員還有結構性優勢:讀完所有 ML 論文、記住每一次實驗、副本之間直接共享思考、訓練好一個等於全部訓練好(不用每個新員工慢慢上手)。

這意味著:人類原本需要 10 年的算法進步,可能在 1 年內被壓完。

然後這 1 年又會再生出更聰明的下一代模型,再壓一輪。從 AGI 到遠超人類的超級智能,可能就是幾個月到一兩年的事。

作者承認有瓶頸------比如實驗需要算力,副本再多也得等 GPU。但他論證瓶頸最多讓爆炸慢一點,不能阻止爆炸。

超級智能長什麼樣

數量級上超人------幾億份並行運行,跨所有學科即時融合,幾周內積累相當於人類千年的經驗。

質性上超人------像 AlphaGo 下出 move 37 那一步(人類專家幾十年都想不到的招),但應用在所有領域。它能找出人類窮盡一生看不出的代碼漏洞,寫出人類永遠讀不懂的代碼。

我們會像小學生看博士論文。

後果是:機器人學被解決(這主要是 ML 算法問題不是硬體問題)、合成生物學武器化、隱形無人機蜂群可以先發摧毀核武器。

整個國際軍事平衡會在幾年內被推翻。

第三部分:四個真正緊迫的麻煩

麻煩一:萬億美元集群

這場競賽不只是碼農寫代碼,是工業動員。

每代模型需要更大集群,更大集群需要電廠,電廠需要晶片廠。

按現在節奏:2026 年 1GW 集群(一個胡佛大壩的電),2028 年 10GW(一個中等美國州),2030 年 100GW(美國全部發電的兩成多)。

投資規模 2027 年可能突破 1 萬億美元/年。

真正卡脖子的不是錢也不是 GPU,是電。"我去哪找 10GW?"是 SF 現在最火的話題。

要在美國本土建成,必須放鬆環保審批、動用聯邦權力解鎖土地------作者把這個上升到國家安全級別。

如果美國建不出,集群就會跑去阿聯酋、沙特,等於把 AGI 鑰匙交給其他國家。

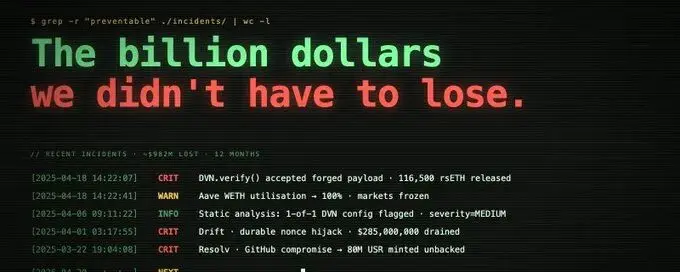

麻煩二:實驗室就是漏的

現在的 AI 實驗室,安全水平等於普通矽谷創業公司。

Google DeepMind(業內最好的)自己承認對國家級對手的防禦能力是 0 級(滿分 4 級)。

這意味著什麼?AGI 模型的"權重"本質就是伺服器上一個大文件。

這個文件被偷走,等於把"自動化 AI 研究員"直接交給中國------他們立刻可以跑自己的智能爆炸,美國所有領先歸零。

更緊迫的是算法機密------下一代範式的關鍵突破(怎麼破數據牆)正在 SF 各家公司 的 Slack 裡、辦公桌窗外形成。

作者斷言:未來 12 到 24 個月,關鍵 AGI 突破會洩漏給中國。不是 maybe,是幾乎一定。

要做到能擋住中國的安全水平,需要硬體級隔離、人员背調到原子彈工程師等級、專門的集群設計------這些至少要幾年時間迭代才能建成。如果不立刻動手,2027 拿到 AGI 時安全跟不上,到時只有兩個糟糕選項:要麼直接送給別的國家,要麼停下來等安全建好(可能丟掉領先)。

麻煩三:對齊問題

現在的對齊技術叫 RLHF------人給模型評分,模型學著討好人。

這招對比人類笨的 AI 有效。一旦 AI 比人類聰明幾個數量級,這招徹底失效------你怎麼評判一份你看不懂的博士論文?

智能爆炸把這件事搞得極其緊張:

不到一年內,從"RLHF 還管用"跳到"RLHF 完全失靈",沒有時間迭代試錯。

同時從"小錯誤"(ChatGPT 說髒話)跳到"災難性錯誤"(超級智能從集群裡跑出去黑掉軍方系統)。

中間架構經歷多代演化,最終的超級智能我們完全看不懂它怎麼思考的。

現在的模型用英文 token 推理(相對透明),未來大概率會演化到內部 latent state 推理------徹底不可解釋。

作者對技術解決方案樂觀:低懸果實多,可解釋性研究有進展。

但對組織執行極度悲觀------全球嚴肅做這件事的人不超過幾十個,實驗室沒有為安全付出代價的跡象。"我們在過度依賴運氣。"

麻煩四:自由世界必須贏

作者花大量篇幅論證:有的國家不僅沒出局,而且很有競爭力。

算力上:華為 7nm 晶片(中芯產)性能是英偉達 A100 級,性價比差 2-3 倍但夠用。

建設能力:中國過去十年新增電力等於美國全部發電裝機。建 100GW 集群的工業動員力,中國可能比美國強。

盜竊路徑:只要美國實驗室不鎖,關鍵算法兩年內必然洩漏。

時間線上有個令人不安的巧合:AGI 時間線(~2027)和台海觀察家的中共攻台時間窗(~2027)正在收斂。"AGI 終局有可能在世界大戰背景下展開。"

作者的結論:美國必須保持"健康領先"------他建議 2 年。這兩年緩衝是用來穩定局勢、和中國談判後超級智能時代的國際秩序。

少於這個領先,整個世界會被推入"通過智能爆炸的存亡競速"------所有安全裕度歸零,所有人為求快裸奔。

第四部分:The Project(AGI 版曼哈頓工程)

到這裡作者拋出全書最大膽的預測。

"美國政府讓一家 SF 創業公司開發超級智能"是不可能的。想像一下當年用 Uber 開發原子彈。

預測:2027 或 2028 年某個時點,美國國家安全機器會以某種形式接管 AGI 項目。形態可能是國防承包商模式(OpenAI 變成洛克希德·馬丁)、合資模式(雲廠商+實驗室+政府)、甚至更極端的國有化。

核心研究員搬進 SCIF 安全設施,萬億美元集群以戰時速度建成。

形成路徑:2026/27 出現第一次真正嚇人的能力展示------可能是"幫新手造生物武器",可能是 AI 自主黑入關鍵基礎設施。

疊加 CCP 滲透實驗室的細節被揭露,華盛頓氛圍突變。"我們需要 AGI 曼哈頓工程嗎?"先慢慢、然後突然成為頭號議題。

為什麼必須是政府?因為超級智能屬於核武器類,不屬於互聯網類。私營公司從來不被允許持有完整核武器。

要做到能抵禦中國全力的安全等級,只有政府基礎設施能做。要管理智能爆炸這種"一年內一切重寫"的過程,需要核啟動協議級的指揮鏈,不是創業公司董事會。

作者對政府效率沒幻想(曼哈頓工程也曾被官僚拖延),但沒有更好選擇。

第五部分:作者的告白

作者批評兩個對立陣營都搞錯了:

加速主義者(e/acc)天真地認為市場會自我調節,忽視對齊和安全的真實難度。

末日論者主張暫停一切------但中國不會暫停,暫停就是認輸。

正確姿態作者叫AGI 現實主義:

①超級智能是國家安全決定性技術

②風險真實存在且我們沒準備好

③美國必須做 The Project 並主導後超級智能國際秩序。

灣區幾條街上的幾百號人,正在決定整個文明的走向。