Talkie: 현대 지식을 벗겨내고 AI의 기본 능력을 재조명하다

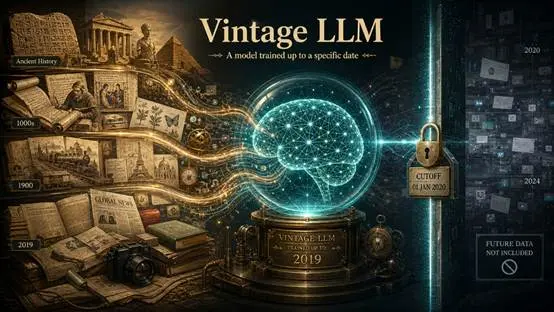

최근, Talkie라는 이름의 복고풍 언어 모델이 AI 분야에서 논의를 불러일으켰습니다. 이 모델의 핵심 특징은 훈련 데이터의 극도로 제한된 것입니다. 13B 매개변수를 가진 이 모델은 2600억 토큰을 기반으로 훈련되었으며, 주로 1931년 이전의 영어 텍스트를 읽었습니다. 여기에는 구서, 신문, 저널, 과학 논문, 특허 및 백과사전이 포함됩니다. 공식적으로는 빈티지 언어 모델로 정의됩니다.

더 큰 맥락, 더 넓은 지식 범위 및 실시간 업데이트를 추구하는 시대에 Talkie의 설정은 이상하게 보입니다.

현대 대형 모델은 일반적으로 현대 인터넷 코퍼스에서 훈련됩니다. 이들은 Python 코드에 익숙하고, GitHub 이슈에 익숙하며, 오늘날의 소셜 미디어 맥락에 익숙합니다. 반면 Talkie는 1930년대 지식의 경계에 갇힌 연구 객체처럼 보입니다. 이 모델은 2차 세계 대전 이후의 세계를 보지 못했으며, 진정한 인터넷, 암호화폐 또는 현대 소프트웨어 공학에 접촉한 적이 없습니다. 현대 지식의 이러한 분리는 그것을 관찰 모델의 기본 능력을 실험하는 샘플로 만듭니다.

지식과 기본 능력의 분해

Talkie를 통해 연구자들은 본질적인 문제를 관찰할 수 있습니다: 모델이 현대 세계를 보지 못했다면, 언어 구조와 맥락 예시에서 얼마나 많은 능력을 배울 수 있을까요?

현대 모델의 평가에서, 논리적 추론은 종종 자료 기억과 혼합됩니다. 모델이 Python 코드나 현대 정치 문제에 정답을 제시할 때, 우리는 그것이 진정으로 기본 능력을 갖추고 있는지, 아니면 단순히 훈련 데이터에 관련 테스트 문제가 포함되어 있었는지 구분하기 어렵습니다. Talkie는 이 두 가지를 구분했습니다:

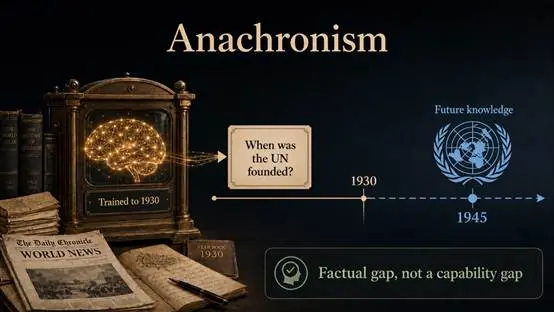

- 시대 불일치(Anachronism): 만약 그것이 "유엔이 언제 설립되었는지" 모른다면, 이는 언어 이해 능력이 떨어진다는 것을 의미하지 않습니다. 왜냐하면 1930년 이전에는 유엔의 개념이 없었기 때문입니다. 이는 지식 결핍에 해당하며, 능력 결핍이 아닙니다.

- 패턴 일반화: 연구자들은 Talkie가 Python을 전혀 보지 못했음에도 불구하고, 몇 개의 few-shot 예시를 통해 언어 구조를 통해 매우 간단한 코드 논리를 유도할 수 있다는 것을 발견했습니다. 이는 Transformer 구조 자체가 기본적인 일반화 능력을 갖추고 있음을 증명하며, 단순히 기억에 의존하는 것이 아님을 보여줍니다.

"쌍둥이" 대조 실험

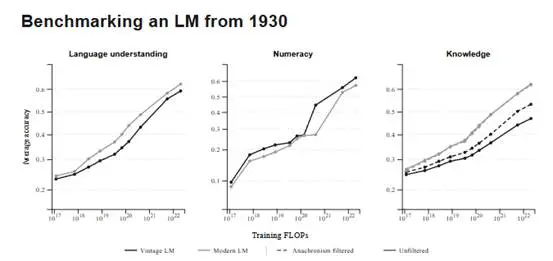

데이터 분포의 영향을 검증하기 위해, 연구 팀은 완전히 동일한 구조의 모던 쌍둥이를 만들었습니다. 차이점은 후자가 현대 웹 데이터 FineWeb을 읽었다는 것입니다.

처음에 Talkie는 표준 테스트에서 전반적으로 뒤처졌지만, 이는 1930년 이후 지식이 부족한 모델에게는 공정하지 않았습니다. 흥미롭게도, 연구자들이 1930년 관점에서 "미래"에 해당하는 문제를 필터링했을 때, Talkie와 현대 모델 간의 성능 차이는 약 절반으로 줄어들었습니다.

이는 언어 이해의 기본 능력이 현대 인터넷에 전적으로 의존하지 않음을 나타냅니다. 고품질의 구 신문, 과학 저널 및 법률 문서에는 이미 인간이 축적한 상식 패턴, 논리적 인과관계 및 논증 규칙이 내재되어 있습니다. 모델이 이러한 텍스트에서 배운 것은 개념이 어떻게 연결되고, 증거가 판단을 어떻게 지지하는지이며, 이러한 기본 논리는 시대에 따라 높은 안정성을 가지고 있습니다.

디자인 원칙에 대한 영감

추적 가능성, 검증 및 추론 경로에 중점을 둔 AI 시스템에 대해 Talkie는 유용한 디자인 원칙을 제시했습니다: 모델 본체가 모든 새로운 사실을 매개변수에 압축할 필요는 없습니다.

더 견고한 경로는 기본 모델이 안정적인 언어 능력, 추론 구조 및 일반 패턴에 집중하는 것입니다. 이러한 능력은 고품질, 고밀도의 역사적 텍스트에서 습득할 수 있습니다. 최신 사실, 기술 규범 및 실시간 정보는 검색 시스템, 지식 베이스 및 도구 호출에 맡기는 것이 좋습니다.

모델이 이해와 분해를 담당하고, 외부 시스템이 업데이트와 실행을 담당하게 하십시오. 이는 단순히 더 큰 사전 훈련 코퍼스를 추구하고 모델이 기억에 의존하는 "문제 풀이기"가 되는 것보다 실제 생산 환경의 요구에 더 가깝습니다.

결론

Talkie의 가치는 명확한 실험 경계를 설정하는 데 있습니다. 이는 업계에 경고합니다: "새로운 자료"를 "새로운 능력"과 직접적으로 동일시하지 말고, "지식 범위"를 "기본 능력"과 직접적으로 동일시하지 말라는 것입니다.

AI의 진화 논리는 이동하고 있습니다: 끝없이 웹 데이터를 쌓는 것보다, 정제된 코퍼스에서 논리적 프레임워크를 정립하고 외부 지식 베이스를 호출하여 실전 문제를 해결하는 시스템이 다음 단계의 경쟁 핵심에 더 가깝습니다.