거대 기업들이 시장에 진출하고, VC들이 돈을 쏟아붓고 있다. "AI 마음 읽기"를 위해 이들 회사들이 미쳐가고 있다

저자:Lexie

편집:Lu

AI에 대한 대토론에서 사람들은 AI에게 부여한 역할이 우리의 가장 유능한 효율적 조수이거나 우리를 전복할 "기계 군단"이 될 것이라고 주장합니다. 적이든 친구든 AI는 인간이 부여한 임무를 완수할 수 있을 뿐만 아니라 "마음을 읽을 수" 있어야 하며, 이러한 독심술 능력은 올해 AI 분야의 주요 화두가 되었습니다.

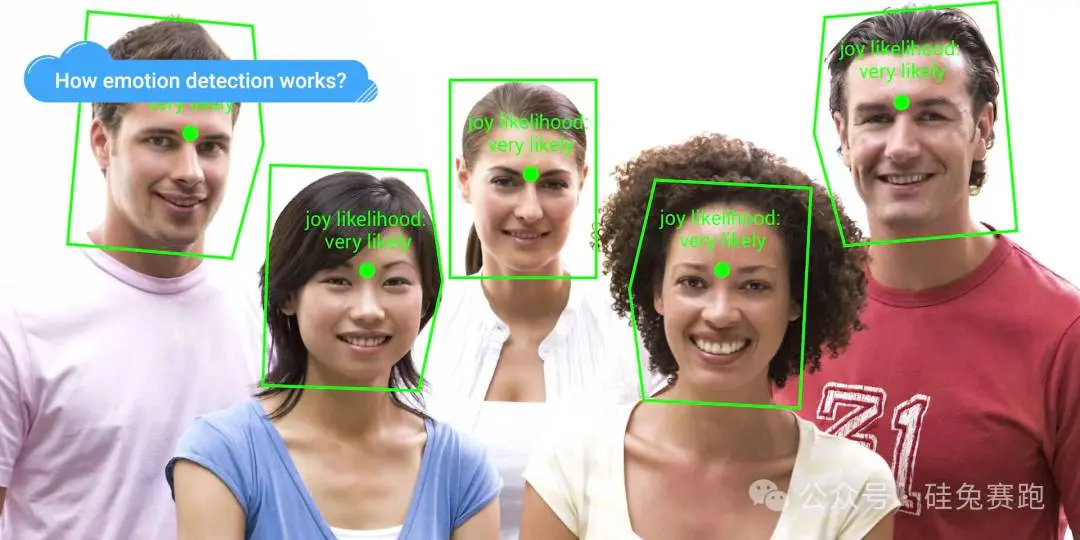

PitchBook이 올해 발표한 기업 SaaS 신흥 기술 연구 보고서에서 "감정 AI"는 큰 기술적 하이라이트가 되었으며, 이는 감정 계산 및 인공지능 기술을 사용하여 인간의 감정을 인식하고 이해하며 상호작용하려는 시도를 의미합니다. 텍스트, 얼굴 표정, 음성 및 기타 생리적 신호를 분석하여 인간의 감정을 이해하려고 하며, 간단히 말해 감정 AI는 기계가 인간처럼, 심지어 인간보다 더 잘 감정을 "읽을 수" 있기를 희망합니다.

주요 기술에는 다음이 포함됩니다:

얼굴 표정 분석: 카메라, 컴퓨터 비전 및 딥러닝을 통해 미세한 표정과 얼굴 근육의 움직임을 감지합니다.

음성 분석: 음성 인식, 어조, 리듬을 통해 감정 상태를 인식합니다.

텍스트 분석: 자연어 처리(NLP) 기술을 통해 문장과 맥락을 해석합니다.

생리 신호 모니터링: 웨어러블 장치를 사용하여 심박수, 피부 반응 등을 분석하여 상호작용의 개인화와 감정의 풍부함을 향상시킵니다.

Emotion AI

감정 AI의 전신은 감정 분석 기술로, 주로 텍스트 상호작용을 통해 분석합니다. 예를 들어, 소셜 미디어에서 텍스트를 통해 사용자 감정을 분석하고 추출하는 것입니다. AI의 지원으로 시각 및 오디오 등 다양한 입력 방식을 통합하여 감정 AI는 보다 정확하고 완전한 감정 분석을 약속합니다.

01 VC 자금 지원, 스타트업 대규모 자금 조달

실리콘밸리의 관찰에 따르면, 감정 AI의 잠재력은 많은 투자자들의 관심을 끌었으며, 이 분야에 집중하는 여러 스타트업인 Uniphore, MorphCast 등이 이 경로에서 대규모 투자를 받았습니다.

캘리포니아의 Uniphore는 2008년부터 기업에 자동화된 대화 솔루션을 제공하기 위해 탐색해 왔으며, U-Self Serve, U-Assist, U-Capture 및 U-Analyze 등 여러 제품 라인을 개발하여 고객이 음성, 텍스트, 시각 및 감정 AI 기술을 통해 보다 개인화되고 감정이 풍부한 상호작용을 할 수 있도록 돕고 있습니다. U-Self Serve는 대화 중 감정과 어조를 정확하게 인식하여 기업이 사용자 참여 만족도를 높이기 위해 보다 개인화된 서비스를 제공할 수 있도록 합니다;

U-Self Serve

U-Assist는 실시간 안내 및 작업 흐름 자동화를 통해 고객 서비스 에이전트의 작업 효율성을 높일 수 있습니다. U-Capture는 자동화된 감정 데이터 수집 및 분석을 통해 기업이 고객의 요구와 만족도에 대한 깊은 통찰력을 가질 수 있도록 합니다. U-Analyze는 고객이 상호작용 중의 주요 트렌드와 감정 변화를 식별할 수 있도록 도와주며, 데이터 기반의 의사결정 지원을 통해 브랜드 충성도를 강화합니다.

Uniphore의 기술은 단순히 기계가 언어를 이해하도록 하는 것이 아니라, 인간과 상호작용할 때 어조와 표정 뒤에 숨겨진 감정을 포착하고 해석할 수 있도록 하는 것입니다. 이러한 능력은 기업이 고객과 상호작용할 때 단순히 기계적으로 대응하는 것이 아니라, 고객의 감정적 요구를 더 잘 충족할 수 있도록 합니다. Uniphore를 사용하면 기업의 사용자 만족도가 87%에 달하고 고객 서비스 성과가 30% 향상됩니다.

Uniphore는 현재까지 6억 2천만 달러 이상의 자금을 조달했으며, 최근 라운드는 2022년 NEA가 주도한 4억 달러의 투자로, March Capital 등 기존 투자자들도 참여했습니다. 이 라운드 이후 기업 가치는 25억 달러에 달했습니다.

Uniphore

Hume AI는 세계 최초의 공감 능력을 가진 음성 AI를 출시했습니다. 이는 전 Google 과학자 Alan Cowen이 설립했으며, 그는 음성, 얼굴 및 제스처의 미세한 차이를 통해 감정 경험과 표현을 이해하는 의미 공간 이론을 창안한 것으로 유명합니다. Cowen의 연구 결과는 "자연" 및 "인지 과학 동향" 등 여러 저널에 발표되었으며, 지금까지 연구된 가장 광범위하고 다양한 감정 샘플을 포함하고 있습니다.

이 연구를 기반으로 Hume은 대화형 음성 API인 EVI를 개발했습니다. 이는 대형 언어 모델과 공감 알고리즘을 결합하여 인간의 감정 상태를 깊이 이해하고 해석할 수 있습니다. EVI는 음성에서 감정을 인식할 뿐만 아니라 사용자와의 상호작용에서 더욱 세밀하고 개인화된 반응을 할 수 있으며, 개발자는 몇 줄의 코드로 이러한 기능을 사용할 수 있고, 이를 모든 애플리케이션에 내장할 수 있습니다.

Hume AI

현재 대부분의 AI 시스템의 주요 제한 중 하나는 지시가 주로 인간에 의해 제공된다는 점입니다. 이러한 지시와 힌트는 오류가 발생하기 쉽고 인공지능의 잠재력을 충분히 발휘하지 못하게 합니다. Hume이 개발한 공감 대형 언어 모델(eLLM)은 맥락과 사용자의 감정 표현에 따라 사용하는 단어와 어조를 조정할 수 있으며, 인간의 행복을 첫 번째 원칙으로 하여 기계 학습, 조정 및 상호작용을 진행합니다. 이는 심리 건강, 교육 훈련, 응급 호출, 브랜드 분석 등 여러 분야에서 사용자에게 보다 자연스럽고 진정한 경험을 제공합니다.

올해 3월 Hume AI는 EQT Ventures가 주도한 5천만 달러 B 라운드 자금을 조달했으며, 투자자는 Union Square Ventures, Nat Friedman & Daniel Gross, Metaplanet 및 Northwell Holdings 등입니다.

이 분야에는 소비자의 인지 및 감정 반응을 측정하는 Entropik도 있습니다. 이 회사는 감정 AI, 행동 AI, 생성 AI 및 예측 AI의 통합 기능인 Decode를 통해 소비자의 행동과 선호를 더 잘 이해하고, 보다 개인화된 마케팅 제안을 제공합니다. Entropik은 최근 2023년 2월 2천5백만 달러 B 라운드 자금을 조달했으며, 투자자는 SIG Venture Capital 및 Bessemer Venture Partners입니다.

Entropik

02 대기업 참여, 혼전 양상

기술 대기업들은 자사의 강점을 바탕으로 감정 AI 분야에도 진출하고 있습니다.

Microsoft Azure의 인지 서비스 감정 API는 얼굴 표정과 감정을 분석하여 이미지와 비디오에서 기쁨, 분노, 슬픔, 놀람 등 다양한 감정을 인식할 수 있습니다;

IBM Watson의 자연어 이해 API는 대량의 텍스트 데이터를 처리하여 그 뒤에 숨겨진 감정 경향(예: 긍정적, 부정적 또는 중립적)을 인식하여 사용자 의도를 보다 정확하게 해석합니다;

Google Cloud AI의 Cloud Vision API는 강력한 이미지 분석 기능을 갖추고 있어 이미지 내 감정 표현을 신속하게 인식할 수 있으며, 텍스트 인식 및 감정 연관도 지원합니다;

AWS의 Rekognition은 감정을 감지하고 얼굴 특징을 인식하며 표정 변화를 추적할 수 있으며, 다른 AWS 서비스와 결합하여 완전한 소셜 미디어 분석 또는 감정 AI 기반 마케팅 애플리케이션이 될 수 있습니다.

Cloud Vision API

일부 스타트업은 감정 AI 분야에서 연구 개발 속도가 더 빠르며, 심지어 기술 대기업들이 인재를 "채용"해야 할 정도입니다. 예를 들어 유니콘 Inflection AI는 투자자 Microsoft가 AI 팀과 모델을 주목하여, Bill Gates, Eric Schmidt 및 NVIDIA 등 여러 파트너와 함께 Inflection AI에 13억 달러를 투자한 후, AI 분야의 선두주자인 Inflection AI의 공동 창립자 중 한 명인 Mustafa Suleyman에게 손을 내밀었습니다. 이후 Suleyman과 70명 이상의 직원이 Microsoft로 이직했으며, Microsoft는 이를 위해 약 6억 5천만 달러를 지불했습니다.

그러나 Inflection AI는 곧 재정비하여 Google 번역, AI 컨설팅 및 AR 등 다양한 배경을 가진 새로운 팀을 구성하고, 핵심 제품인 Pi에 지속적으로 힘을 쏟고 있습니다. Pi는 사용자의 감정을 이해하고 반응할 수 있는 개인 비서로, 전통적인 AI와는 달리 사용자와의 감정적 연결을 더욱 중시합니다. 음성, 텍스트 등의 입력을 분석하여 감정을 인식하고 대화에서 공감을 나타냅니다. Inflection AI는 Pi를 코치, 친구, 경청자 및 창의적 파트너로 여기며 단순한 AI 비서가 아닙니다. 또한 Pi는 강력한 기억 기능을 갖추고 있어 사용자의 여러 대화 이력을 기억하여 상호작용의 연속성과 개인화된 경험을 향상시킵니다.

Inflection AI Pi

03 발전의 길, 관심과 의구심 공존

감정 AI는 보다 인간적인 상호작용 방식을 기대하게 하지만, 모든 AI 기술과 마찬가지로 그 보급은 관심과 의구심을 동반합니다. 첫째, 감정 AI가 정말로 인간의 감정을 정확하게 해석할 수 있을까요? 이론적으로 이 기술은 서비스, 장치 및 기술의 경험을 더욱 풍부하게 만들 수 있지만, 현실적으로 인간의 감정은 본질적으로 모호하고 주관적입니다. 2019년에는 연구자들이 이 기술에 대해 의구심을 제기하며, 얼굴 표정이 인간의 진정한 감정을 신뢰할 수 있게 반영하지 못한다고 주장했습니다. 따라서 기계가 인간의 얼굴 표정, 몸짓 및 어조를 모방하여 감정을 이해하는 것은 일정한 한계가 있습니다.

둘째, 엄격한 법규 제재는 AI 발전의 장애물로 작용해 왔습니다. 예를 들어, 유럽연합의 AI 법안은 교육과 같은 분야에서 컴퓨터 비전 감정 감지 시스템의 사용을 금지하고 있어 일부 감정 AI 솔루션의 보급을 제한할 수 있습니다. 미국 일리노이주와 같은 주에서도 허가 없이 생체 인식 데이터 수집을 금지하는 법률이 있어 감정 AI 기술 사용의 전제를 직접적으로 제한합니다. 또한 데이터 프라이버시와 보호는 중요한 문제로, 감정 AI는 교육, 건강, 보험 등 데이터 프라이버시 요구가 특히 엄격한 분야에 주로 적용되므로 감정 데이터의 안전하고 합법적인 사용을 보장하는 것은 모든 감정 AI 회사가 직면해야 할 과제입니다.

마지막으로, 서로 다른 문화와 지역의 사람들 간의 소통 및 감정 해석은 어려운 문제이며, AI에게는 더욱 큰 시험이 될 수 있습니다. 예를 들어, 지역에 따라 감정의 이해와 표현 방식이 다르기 때문에 감정 AI 시스템의 유효성과 완전성에 영향을 미칠 수 있습니다. 또한 감정 AI는 인종, 성별 및 성 정체성 편견을 처리하는 데에도 상당한 어려움에 직면할 수 있습니다.

감정 AI는 인력을 줄이는 효율성을 약속할 뿐만 아니라 사람의 마음을 읽는 배려를 가지고 있지만, 과연 이것이 인간 상호작용의 만능 해결책이 될 수 있을까요? 아니면 Siri와 비슷한 스마트 비서로 남아 진정한 감정 이해가 필요한 작업에서 평범한 성과를 보일까요? 아마도 미래에는 AI의 "독심술"이 인간과 기계, 심지어 인간 간의 상호작용을 혁신할 수 있겠지만, 현재로서는 인간의 감정을 진정으로 이해하고 반응하기 위해서는 여전히 인간의 참여와 신중함이 필요할 것입니다.