未来十年を一文で語る、天才少年のAI投資聖典:《状況認識》

著者:@giantcutie666

2024年、00後の少年天才Leopold AschenbrennerがOpenAIを退職し、ファンドを始めました。

同時に自分の投資思考をまとめました:

今振り返ると、この165ページの論文《状況認識(Situational Awareness: The Decade Ahead)》はすでに神格化されています。

昨年理解できた人は、今年確実に財産自由を手に入れたことでしょう!

私は165ページの英語原版を"こちら"に置いています。以下は私ができる限り簡潔にまとめた内容です:

https://situational-awareness.ai/wp-content/uploads/2024/06/situationalawareness.pdf

論文の主なポイントは:この10年以内に人類は(普通の人のすべての仕事をこなせる)AGIを作り、その後にスーパーインテリジェンスが続くということです。

今このことを理解できるのは数百人に満たず、大半はサンフランシスコの数街に集中しています。他の人々------ウォール街、メディア、ワシントン------はまだ反応していません(今年ウォール街の一部の人々も反応し始めました)。

第一部:なぜ2027年にAGIが実現するのか

方法は単純ですが効果的です:時間を予測せず、計算能力の規模を予測します。

過去4年間、GPT-2からGPT-4にかけて、モデルの「有効計算能力」は約10万倍増加し、半年ごとに10倍増加しています!

GPT-2は幼稚園の子供がなんとか半分通じる文を書くようなもので、GPT-4は賢い高校生が弁護士資格試験に合格し、博士レベルの科学問題を解くことができるようなものです。

この10万倍は3つの要因から来ています:

第一に、ハードウェアにお金をかけること。トレーニングに必要な計算能力は毎年3倍以上増加しています。ムーアの法則は年間1.3倍ですが、AIは人々が資金を投入し、特にAIチップを作ることで5倍の速度で進化しています。

第二に、アルゴリズムが賢くなっています。同じ数学的能力に達するための推論コストは、2年前の1000分の1になっています。これはアルゴリズムエンジニアが生み出したものです。

第三に、デフォルトで抑制されている能力を解放する(unhobbling)ことが最も興味深いです。

モデル自体には多くの能力がありますが、デフォルト設定によって抑えられています。例えば、ChatGPTの以前のベースモデルは実際には非常に賢いですが、使うと意味不明なことを言います------RLHFがそれを解放しました。

また、モデルに「考える時間を与える」(chain of thought)ことで推論能力が解放されます。さらに、ツールを使わせたり、長期記憶を持たせたりすることで、さらに一層解放されます。

今後4年間(2027年まで)、著者はこれら3つの道がさらに10万倍になると予測しています。

最も重要な洞察はunhobblingに隠れています:

現在のモデルは一度の推論で「数分間考える」ことしかできません------約数百のトークンです。もし「数ヶ月考える」ことができれば------百万のトークン------どうなるでしょうか?

例えば、あなたとアインシュタインの差は、「あなたが5分考える」と「あなたが5ヶ月考える」の差ほどではありません。

この解放が実現すれば、3から4の数量級の知能の飛躍に相当します。この果実はすでに見えています。

この外挿に従えば、2027年頃には、リモート社員のように数週間独立して働き、タスクを自分で計画し、コードを書き、実験を行い、バグを修正し、結果を提出できるAIが現れるでしょう。

OpenAIの研究者を完全に代替できる、これが著者が定義するAGIです。

最大の不確実性はデータの壁から来ています------高品質の公開インターネットデータはすぐに使い果たされるでしょう。

第二部:AGIは終点ではなく、引爆点である

AIがAI研究者の仕事をできるようになったら、何が起こるでしょうか?

計算能力は変わらないが、「世界中のOpenAI/Anthropic/DeepMind合わせて数百人の研究者」の制約を受けなくなります------あなたは1億のAI研究者のコピーを走らせることができ、それぞれが人間の100倍の速度で動作します。

数日で人間の1年分の仕事を生み出します。

これらの自動化された研究者には構造的な利点があります:すべてのML論文を読み、すべての実験を記憶し、コピー間で直接思考を共有し、1つのコピーを訓練すればすべてが訓練されます(新しい従業員が徐々に慣れる必要がありません)。

これはつまり:人間が10年かけて進歩させるアルゴリズムが、1年以内に圧縮される可能性があるということです。

そしてその1年の間に、さらに賢い次世代モデルが生まれ、再び圧縮されます。AGIから人間を遥かに超えるスーパーインテリジェンスへの移行は、数ヶ月から1、2年のことかもしれません。

著者はボトルネックがあることを認めています------例えば実験には計算能力が必要で、コピーがいくらあってもGPUを待たなければなりません。しかし、彼はボトルネックが爆発を遅らせるだけで、爆発を阻止することはできないと論証しています。

スーパーインテリジェンスはどのようなものか

数量的には超人------数億のコピーが並行して動作し、すべての学問分野を即座に融合し、数週間で人間の千年の経験に相当するものを蓄積します。

質的には超人------AlphaGoがmove 37を打ったように(人間の専門家が数十年考えても思いつかない手)、しかしすべての分野に応用されます。人間が一生かけても見つけられないコードの脆弱性を見つけ、人間が永遠に理解できないコードを書くことができます。

私たちは小学生が博士論文を見るようになります。

結果として:ロボティクスが解決される(これは主にMLアルゴリズムの問題であり、ハードウェアの問題ではない)、合成生物学が武器化され、無人機の群れが先に発進して核兵器を破壊することができます。

国際的な軍事バランス全体が数年以内に覆されるでしょう。

第三部:4つの本当に緊急な問題

問題1:万億ドルのクラスター

この競争は単にプログラマーがコードを書くことではなく、産業動員です。

各世代のモデルにはより大きなクラスターが必要で、より大きなクラスターには発電所が必要で、発電所にはチップ工場が必要です。

現在のペースに従えば:2026年には1GWのクラスター(フーバーダム1基分の電力)、2028年には10GW(中程度のアメリカの州)、2030年には100GW(アメリカ全体の発電の20%以上)になります。

投資規模は2027年には年間1兆ドルを突破する可能性があります。

本当にボトルネックになるのはお金でもGPUでもなく、電力です。「10GWをどこで見つけるのか?」は現在サンフランシスコで最もホットな話題です。

アメリカ本土で建設するためには、環境保護の承認を緩和し、連邦権力を動員して土地を解放する必要があります------著者はこれを国家安全保障のレベルに引き上げています。

もしアメリカがこれを実現できなければ、クラスターはアラブ首長国連邦やサウジアラビアに移転し、AGIの鍵を他国に渡すことになります。

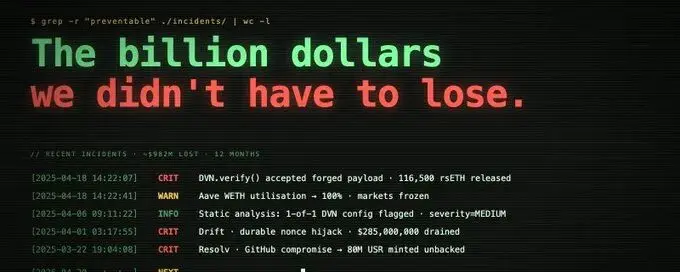

問題2:実験室は漏れています

現在のAI実験室の安全レベルは普通のシリコンバレーのスタートアップと同じです。

Google DeepMind(業界最高)は、自ら国家レベルの対抗者に対する防御能力が0レベル(満点4レベル)であることを認めています。

これは何を意味するのでしょうか?AGIモデルの「重み」は本質的にサーバー上の大きなファイルです。

このファイルが盗まれれば、「自動化されたAI研究者」を中国に直接渡すことになります------彼らはすぐに自分たちの知能爆発を起こすことができ、アメリカのすべてのリードがゼロになります。

さらに緊急なのはアルゴリズムの機密性------次世代のパラダイムの重要な突破(データの壁をどう破るか)がサンフランシスコの各社のSlackやオフィスの窓の外で形成されています。

著者は断言します:今後12から24ヶ月の間に、重要なAGIの突破が中国に漏れるでしょう。これは「もしかしたら」ではなく、ほぼ確実です。

中国に対抗できる安全レベルを確保するためには、ハードウェアレベルの隔離、原子爆弾エンジニアレベルの人員のバックグラウンドチェック、特別なクラスター設計が必要です------これには少なくとも数年の時間がかかります。もしすぐに行動を起こさなければ、2027年にAGIを手に入れた時に安全が追いつかず、その時には2つの悪い選択肢しかありません:他国に直接渡すか、安全が整うまで待つか(リードを失う可能性があります)。

問題3:アライメントの問題

現在のアライメント技術はRLHFと呼ばれています------人がモデルにスコアを付け、モデルは人を喜ばせるように学びます。

この方法は人間よりも劣るAIには効果的です。一旦AIが人間よりも数桁賢くなると、この方法は完全に無効になります------あなたは理解できない博士論文をどう評価しますか?

知能爆発はこの問題を極めて緊迫させます:

1年以内に「RLHFはまだ有効」から「RLHFは完全に無効」に飛躍し、試行錯誤の時間がありません。

同時に「小さなエラー」(ChatGPTが汚い言葉を使う)から「壊滅的なエラー」(スーパーインテリジェンスがクラスターから逃げ出して軍のシステムをハッキングする)に飛躍します。

中間のアーキテクチャは何世代も進化し、最終的なスーパーインテリジェンスは私たちがその思考を全く理解できないものになります。

現在のモデルは英語のトークンで推論しています(比較的透明ですが)、未来は内部の潜在状態で推論するように進化する可能性が高く、完全に説明不可能になります。

著者は技術的解決策に楽観的ですが:低い果実が多く、説明可能性の研究に進展があります。

しかし、組織の実行には極度に悲観的です------この問題に真剣に取り組んでいる人は世界中で数十人しかおらず、実験室には安全のために代償を払う兆候がありません。「私たちは運に過度に依存しています。」

問題4:自由世界は勝たなければならない

著者は大量のページを費やして、ある国々は出遅れているだけでなく、非常に競争力があることを論証しています。

計算能力において:華為の7nmチップ(中芯製)はNVIDIAのA100レベルの性能を持ち、コストパフォーマンスは2-3倍劣りますが、十分に使えます。

建設能力:中国は過去10年間で新たに発電した電力がアメリカ全体の発電設備に相当します。100GWのクラスターを建設するための産業動員力は、中国がアメリカよりも強いかもしれません。

盗難の経路:アメリカの実験室がロックされていなければ、重要なアルゴリズムは2年以内に必ず漏れます。

時間軸には不安な偶然があります:AGIのタイムライン(~2027)と台湾海峡の観察者による中国共産党の攻撃タイムウィンドウ(~2027)が収束しています。「AGIの終局は世界大戦の背景の中で展開する可能性があります。」

著者の結論:アメリカは「健康的なリード」を維持しなければならない------彼は2年を提案しています。この2年間の緩衝は、状況を安定させ、中国と交渉した後のスーパーインテリジェンス時代の国際秩序を確立するためのものです。

このリードがなければ、全世界は「知能爆発による生存競争」に突入し、すべての安全余裕がゼロになり、すべての人が急いで裸で走ることになります。

第四部:プロジェクト(AGI版マンハッタン計画)

ここで著者は本書で最も大胆な予測を投げかけます。

「アメリカ政府があるシリコンバレーのスタートアップにスーパーインテリジェンスを開発させる」というのは不可能です。かつてUberを使って原子爆弾を開発したことを想像してみてください。

予測:2027年または2028年のある時点で、アメリカの国家安全機関が何らかの形でAGIプロジェクトを引き継ぐでしょう。形態は防衛請負業者モデル(OpenAIがロッキード・マーチンに変わる)、合弁モデル(クラウドプロバイダー+実験室+政府)、さらにはより極端な国有化の可能性があります。

核心研究者はSCIF安全施設に移り、万億ドルのクラスターが戦時速度で建設されます。

形成される経路:2026/27年に初めて本当に恐ろしい能力のデモが現れます------「新米に生物兵器を作らせる」かもしれませんし、AIが自律的に重要なインフラにハッキングするかもしれません。

中国共産党が実験室に浸透している詳細が明らかになり、ワシントンの雰囲気が一変します。「私たちはAGIマンハッタン計画が必要ですか?」という問いが、徐々に、そして突然、最重要課題になります。

なぜ政府でなければならないのか?スーパーインテリジェンスは核兵器のようなものであり、インターネットのようなものではありません。民間企業は完全な核兵器を保有することは許可されていません。

中国の全力に対抗できる安全レベルを確保するためには、政府のインフラしかできません。知能爆発のような「1年以内にすべてが書き換えられる」プロセスを管理するには、核起動プロトコルレベルの指揮系統が必要であり、スタートアップの取締役会ではありません。

著者は政府の効率について幻想を抱いていません(マンハッタン計画も官僚によって遅延されました)が、より良い選択肢はありません。

第五部:著者の告白

著者は2つの対立する陣営が間違っていると批判します:

加速主義者(e/acc)は市場が自己調整することを単純に信じ、アライメントと安全の真の難しさを無視しています。

終末論者はすべてを一時停止すべきだと主張しますが------中国は一時停止しません。一時停止は降伏を意味します。

著者が呼ぶ正しい姿勢はAGIリアリズムです:

①スーパーインテリジェンスは国家安全保障の決定的な技術である

②リスクは現実に存在し、